※当ページのリンクには広告が含まれています。

AI音声ツールで議事録を自動化したいのに、誤変換が多くて結局手直しに時間がかかる。

音声入力が思ったより通らず、ツール選定をやり直すべきか迷ってしまう。

この問題については様々な意見がありますが、2026年時点の現場知見では、精度はツールの性能だけで決まらず、録音の条件と運用の設計で大きく変わると整理されています[4]。

本記事では、AI音声ツールの精度が低い原因を体系的に分解し、改善の優先順位と具体的な対処をまとめます。

「なぜ失敗したのか」を特定しやすくなり、次の収録から再現性のある改善につなげられるはずです。

精度は「ツール」よりも「録り方」で決まりやすいです

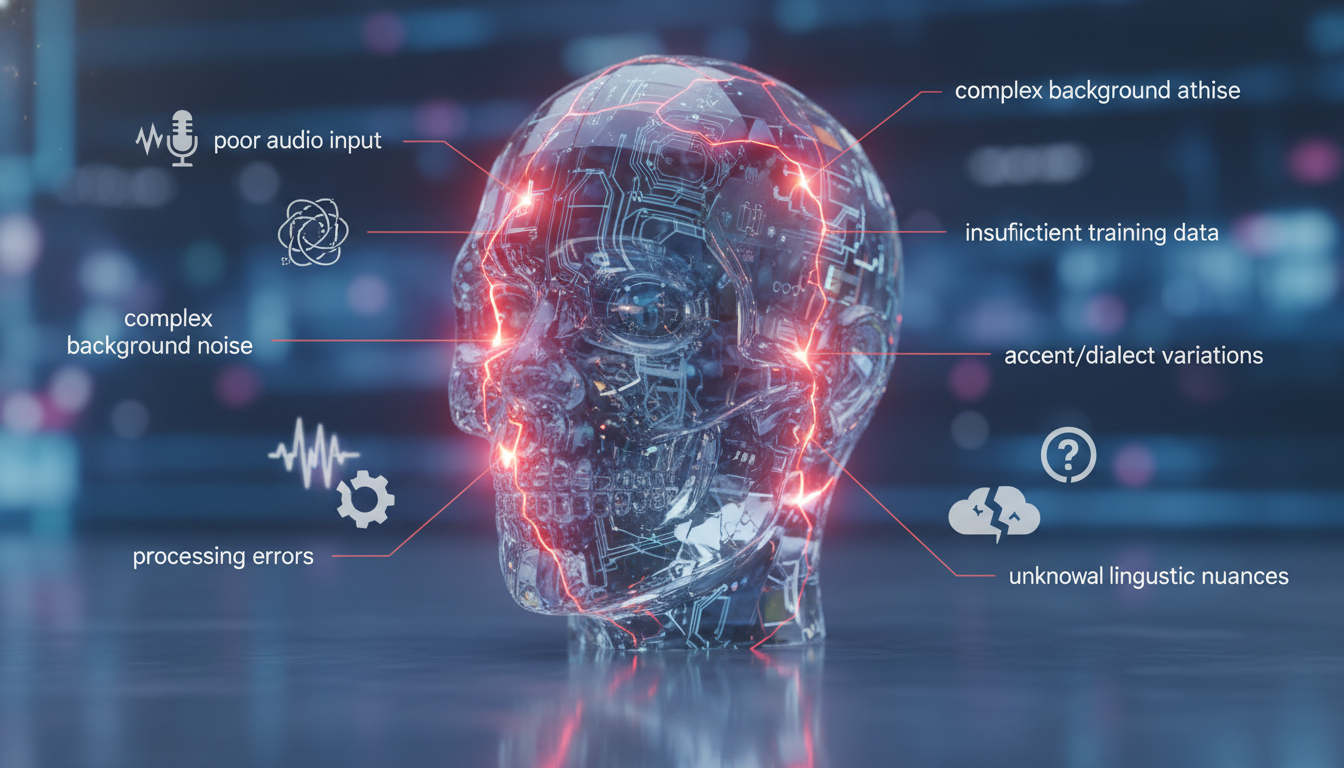

AI音声ツールの精度が低い原因は、単一ではないと報告されています[7]。

録音環境・話し方・機材設定・語彙登録・通信環境などが掛け算で影響し、どれか一つが欠けても結果が崩れやすいと考えられます[7]。

特に重要なのは、2026年時点の最新動向として、精度はツール性能よりも「録り方」で決まるという整理です[4]。

同じツールでも、運用方法の改善だけで精度が大幅に向上することが、現場で確認されています[4]。

また、失敗原因は「背景ノイズ・方言・専門用語・話者識別」の4つが主要因として整理されています[2]。

そのうえで、機材設定や通信品質が加わることで、誤変換や抜け漏れが増える構造です[3][7]。

精度が落ちる原因は7つに分解できます

背景ノイズが多いと、AIが音声を分離できません

録音環境の問題は最大の要因とされています[2]。

空調音、周囲の話し声、キーボード音などが混ざると、AIが「人の声」だけを取り出しにくくなります。

結果として、単語の置き換えや、文の途中が欠ける現象が起きやすくなります。

実測データの例として、ヘッドセットを使用したオペレーターさん側の認識率が90%である一方、通信環境が不安定な顧客さん側は74%に低下した比較が報告されています[3]。

この差は、ツール差というより入力音声の条件差が効いていると考えられます。

マイクが遠いと「声の輪郭」が消えやすいです

対面会議では、マイク距離が遠いと声の輪郭が消え、認識精度が著しく低下すると指摘されています[4]。

机の中央に置いたスマートフォン1台で録る場合、話者さんが少し身体を引いただけで音量と明瞭度が落ち、誤変換が増える可能性があります。

加えて、カフェや会議室のような反響が多い空間では、音が重なって正しく解析できないケースがあるとされています[2]。

反響は「ノイズではないのに聞き取りを難しくする要因」になりやすい点が重要です。

音割れ・途切れは「ごっそり抜け」の原因になります

音声ボリュームが大きすぎると音が割れ、精度が落ちると報告されています[3]。

音割れは、AIにとっては「歪んだ音」であり、正しい音素として扱いにくいと考えられます。

また、通信環境が悪いと音声が途切れ、テキスト化が抜け落ちることもあります[3]。

誤変換よりも厄介なのは、そもそも文字が生成されない区間が発生する点です。

方言・滑舌・話速は誤変換を増やしやすいです

標準語から離れた方言や滑舌の悪さは、認識精度を低下させるとされています[5]。

早口、モゴモゴした話し方、声量の不安定さ、複数人の同時発話も誤変換につながると整理されています[7]。

ここでのポイントは、AIが「意味」を推測する前に、まず「音」を安定して受け取る必要があることです。

入力が不安定だと、文脈補完も外れやすくなる可能性があります。

専門用語・固有名詞が未登録だと、誤変換が固定化しやすいです

専門用語や固有名詞が辞書に登録されていないと、誤変換が多発すると報告されています[1][2]。

社名・製品名・人名・略語が多い会議ほど、誤変換が積み上がりやすいと思われます。

一方で、これらは事前に辞書登録することで改善可能とされています[7]。

運用でカバーできる領域が大きい点は、実務上の救いになります。

機材の性能と設定ミスが、入力品質を下げます

低品質マイク、Bluetooth接続の狭帯域、ゲイン設定の不適切さなどが精度を低下させます[7]。

たとえばゲインが高すぎると音割れし、低すぎるとノイズに埋もれやすくなります。

有線USB接続への切り替えで改善することもあるとされています[7]。

「まずは安定した入力経路を作る」ことが、結果的に最短ルートになりやすいです。

話者識別が崩れると、議事録として使いにくくなります

複数話者の声が混同されると、誰の発言かわからなくなる失敗が発生します[2]。

特にオンライン会議で発言が重なった場合、話者分離が崩れ、後編集の工数が増える可能性があります。

改善は「基本の四点セット」から着手すると再現性が高いです

改善策は多数ありますが、現場では基本の四点セットから着手することが推奨されています[7]。

理由は、精度低下の本質が「AIが判断できる材料が足りない状態」にあると整理されているためです[4]。

つまり、AIが不得意というより、入力条件が不足しているケースが多いと考えられます[6]。

マイク環境を整える(最優先)

- 外付けマイクやヘッドセットを導入します[7]。

- マイク距離を一定にします(口元から一定距離を維持します)。

- 可能であれば有線USB接続にします[7]。

録音場所を工夫する(ノイズと反響を減らします)

- 静かな場所を確保します[2]。

- 反響の少ない空間を選びます[2]。

- 空調やプロジェクターなど定常ノイズ源から距離を取ります。

話し方を整える(AIが聞き取りやすい発話に寄せます)

- 明瞭な発話を意識します[7]。

- 話速を上げすぎないようにします[7]。

- 同時発話を避け、相づちを被せない運用にします[7]。

辞書登録と設定を見直す(誤変換の再発を防ぎます)

- 専門用語・固有名詞を事前登録します[1][2][7]。

- ソフトウェアを最新化します[7]。

- ゲイン設定を最適化し、音割れと小さすぎ問題を避けます[7]。

現場で起きやすい失敗と、改善の具体例

例1:会議室の中央にスマホ1台で録音して誤変換が多い

原因として、マイク距離が遠く声の輪郭が消える問題が疑われます[4]。

会議室は反響も起きやすく、音が重なって解析が難しくなる可能性があります[2]。

改善策は以下が現実的です。

- 各話者さんにピンマイク、または最低でもテーブルマイクを導入します。

- 反響が強い場合は、カーテンを閉める、吸音材のある部屋に変えるなど環境を調整します[2]。

- 同時発話を避ける進行ルールを置きます[7]。

例2:オンライン会議で顧客さん側だけ文字起こしが崩れる

実測でも、通信が不安定な側の認識率が下がることが示されています[3]。

音声の途切れは、誤変換よりも「抜け」を生みやすい点が問題です[3]。

改善策は以下が考えられます。

- 顧客さん側にヘッドセット利用を依頼します(可能な範囲でお願いする形が現実的です)。

- Wi-Fiが不安定な場合は有線LANに切り替えます[3]。

- 重要会議は録音をローカルにも残し、後処理で補完できるようにします。

例3:専門用語が多い定例で、毎回同じ誤変換が出る

専門用語・固有名詞の未登録は誤変換の主要因とされています[1][2]。

このタイプの誤りは、音が良くても発生しやすい点が特徴です。

改善策は以下が有効です。

- プロジェクト辞書を作り、社名・製品名・人名・略語を登録します[7]。

- 議事録で頻出する言い回し(例:施策名、機能名)も登録候補にします。

- ツールのアップデートと設定(言語、話者数設定など)を定期的に見直します[7]。

例4:音割れしているのに気づかず、誤変換が急増する

音量が大きすぎると音が割れて精度が落ちると報告されています[3]。

特に、会議の途中で声が大きい参加者さんが入ると、入力レベルが一気に振り切れる場合があります。

改善策は以下が考えられます。

- 録音前にテスト収録を行い、ピークが割れないレベルに調整します。

- ゲインを固定し、マイク距離で音量を調整できる運用にします[7]。

- 可能であればリミッター機能のある機材や設定を検討します。

原因を分解し、入力品質を上げるほど精度は安定します

AI音声ツールの精度が低い原因は、背景ノイズ、マイク距離と反響、音割れや途切れ、方言や話し方、専門用語未登録、機材設定、話者識別などに分解できます[2][3][4][7]。

これらは独立ではなく掛け算で効くため、ツールの乗り換えだけでは解決しないケースがあります[7]。

改善は、基本の四点セットである「マイク環境」「録音場所」「話し方」「辞書登録と設定」から進めるのが再現性が高いとされています[7]。

本質は、AIが判断できる材料を十分に渡すことにある、という整理が重要です[4]。

次の収録から試すなら、まずは1つだけ条件を変えて検証します

一度に多くを変えると、どの施策が効いたのか判断しづらくなります。

まずはヘッドセットの導入やマイク距離の固定など、効果が出やすい一手から始めるのが現実的です[7]。

そのうえで、誤変換の傾向を「ノイズ由来」「専門用語由来」「話者識別由来」のように分類し、辞書登録や会議運用のルール整備へ広げていくと、議事録作成の手戻りが減っていく可能性があります。

小さな改善を積み重ねることが、結果として最短で精度を安定させる方法になりやすいです。